当你敲击键盘的每一个字符,都可能成为某个AI模型的养料——这不再是科幻设想,而是Meta员工正在经历的现实。

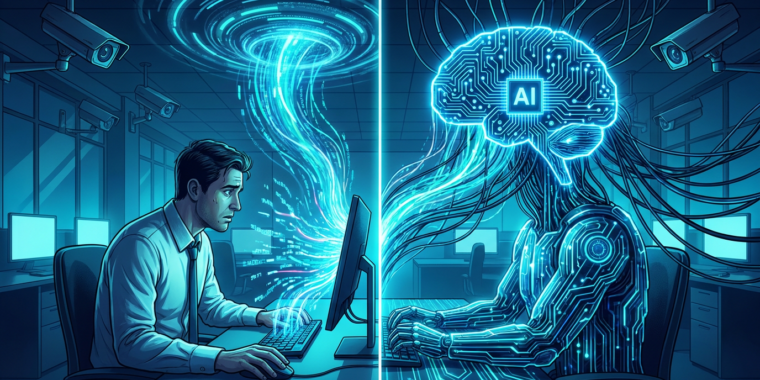

2026年4月下旬,这家社交巨头向全体美国员工发送了一封内部邮件,宣布启动名为”模型能力计划”(Model Capability Initiative,简称MCI)的监控项目。该项目的核心逻辑简单而令人不安:记录员工在办公设备上的每一次鼠标移动、每一次键盘敲击、不定期截取屏幕截图,再将这些数据输送给AI模型,用于训练”更懂人类工作方式的AI代理”。也就是说,你的工作行为本身,正在变成训练你替代者的原材料。

值得注意的是,这不是一次小规模的试点。Business Insider获得的资料显示,Meta强制为美国地区员工部署该软件,员工无权拒绝,且这套监控工具会追踪员工在Google、LinkedIn等主流网站的使用情况。换句话说,你在LinkedIn上找工作时的犹豫点击、你搜索信息时的习惯性操作,都将被纳入Meta的数据管道。这让”反乌托邦”这个词在Meta内部流传,也就不难理解了。

硅谷正在重新定义”人力资源”这个概念

耶鲁大学法学教授Ifeoma Ajunwa对此一针见血地指出:键盘记录与屏幕监控技术过去一直被用于调查员工不当行为,如今被大规模扩展至AI训练用途,意味着白领员工正面临一种前所未有的即时监控强度。这不是管理工具的升级,这是对劳动者隐私边界的根本性突破。更棘手的是内部泄露的另一层担忧:监控数据可能暴露员工密码、新产品开发细节,甚至员工的移民身份和健康信息——这些本应受到法律严格保护的敏感数据,如今和AI训练数据共存于同一条数据流中。

而Meta并非孤例。将视野拓宽,整个硅谷正在经历一场关于”数据来源”的集体焦虑。AI模型的性能瓶颈日益明显,公开网络数据的质量和规模正在触及天花板,各厂商不约而同地将目光投向了”合成数据”和”真实行为数据”。前者是AI自己生成的数据,后者便是像MCI这样,从真实人类的操作行为中提取的训练语料。区别在于,前者仍是模型的自循环,后者则意味着将人本身工具化。Meta的MCI,某种程度上是这一趋势最激进也最露骨的表达。

更深层的矛盾在于,这场实验的受益者正在利用从业者的焦虑来推进它。Threads上一条获得广泛传播的帖子透露,MCI宣布后紧接着便是新一轮裁员计划,并伴随对约6000个岗位的招聘冻结。换句话说,员工被告知:你的工作行为将被用来训练可能取代你的AI,而你还无法选择退出。这不仅是一个商业决策,更是一种心理控制——用不确定性取代安全感,用”被监控的贡献”取代”被尊重的雇佣关系”。

值得关注的是,企业AI伦理的边界正在悄然位移。Inc杂志的一篇评论援引了针对Z世代员工的专项研究,指出这种监控策略最容易破坏的恰恰是年轻员工群体的信任感——而这个群体恰恰是科技公司最依赖的创造力和创新来源。对他们而言,被追踪的每一次鼠标滑动不仅是对隐私的侵犯,更是对”被当作人来对待”这一基本期待的否定。当监控成为组织文化的底色,创新就会从缝隙中逃走。

Meta这场实验的终局尚未揭晓,但它已经撬动了一个远比这家公司更宏大的问题:当AI的进化需要以真实人类的行为数据为燃料时,我们是否愿意接受自己成为那把柴火?而那些掌握柴火的人,是否有权决定这把火烧向何方?这些问题不会因为Meta的一声内部公告而消失,只会随着更多企业跟进而变得更加尖锐。你每一次点击鼠标的瞬间,都可能有人在计算它对某个模型的商业价值——这或许才是AI时代最令人不安的效率悖论。